(江西师范大学计算机与信息工程学院,江西 南昌 330022)

(School of Computer Information Engineering,Jiangxi Normal University,Nanchang 330022,China)

DOI: 10.6043/j.issn.0438-0479.201909013

备注

目前性能最优的译文质量估计系统使用神经机器翻译中的编码器-解码器模型作为特征提取器.该方法由于限制词表大小易导致数据稀疏问题,从而使得较多的未登陆词不能被正确评价.为了缓解上述问题,在详细分析不同子词切分方法的特点后,提出了基于字节对编码(BPE)子词切分和基于一元文法语言模型子词切分的神经译文质量估计方法,并将两者的译文质量估计的得分与基于词语切分的神经译文质量估计得分融合后进行译文质量估计.在WMT18句子级别译文质量估计子任务数据集上的实验结果表明:融合BPE子词切分、一元文法语言模型子词切分和词语切分的神经译文质量估计方法的性能在多个评测子任务上超过了WMT18给出的最好参与系统,深入的实验分析进一步揭示了融合不同粒度的句子切分方法提高了译文质量估计的健壮性.

Nowadays, the state-of-the-art translation quality estimation system takes the encoder-decoder model in neural machine translation as feature extractor.Duing to the restriction of vocabulary size,this method is prone to data sparseness,so that many out-of-vocabulary words can't be correctly evaluated.To tackle the data sparse issues,we propose the neural quality estimation approaches based on the byte-pair-encoding(BPE)subword unit and unigram language model subword unit after a detailed discussion of the characteristic of different subword segmenters.Furthermore,results of the neural quality estimation systems based on BPE subwords and that of the unigram language model subwords are combined with the results of the neural quality estimation systems based on words.Experimental results on the data sets of WMT18 sentence-level quality estimation tasks show that the ensemble system combining the results of the neural quality estimation systems based on BPE subwords,unigram language model subwords and words perform better than the best participated systems on several translation directions in WMT18 quality estimation task.Deep analyses further reveal that the ensemble system combining the results of neural quality estimation systems based on different granularity segmentations improve the robustness of the quality estimation system.

引言

随着全球化时代的到来和我国“一带一路”倡议的不断推进,国际交流日趋频繁.机器翻译减轻了不同国家和地区的人们在信息交流中因为语言差异带来的障碍.机器译文质量估计作为机器翻译的一个重要研究内容,它不仅为机器翻译用户提供了一个度量译文可靠程度的参考指标,而且可以辅助人工译员进行机器译文的后编辑,因此,它在机器翻译的发展和应用中发挥着重要的作用.

传统的译文质量估计方法利用有监督的回归/分类模型对其进行建模,QuEst[1]是其中最具代表性的一个译文质量估计框架.QuEst从源语言句子和机器译文对中抽取多种描述反映翻译质量的特征,包括流利度指标、忠实度指标和翻译复杂度指标等; 然后通过网格搜索进行特征权重学习,利用基于径向基函数核的支持向量机回归模型估计机器译文的质量.但是,它在特征提取时需要对译文进行复杂的语言学分析,包括词性分析、句法分析、语义角色标注等; 这些语言学分析需要额外的资源,且与待估计的机器译文语言种类相关,这导致该方法不易扩展,且泛化性差.

近年来,深度学习在自然语言处理中取得了极大的成功,如使用循环神经网络(recurrence neural network,RNN)构建的语言模型[2]、词语的分布式表示方法[3]、基于编码器-解码器的神经机器翻译(NMT)模型[4-8]等基于深度学习的模型被提出.因此,一些研究工作尝试利用深度神经网络模型解决译文质量估计问题.为了克服QuEst框架中特征提取需要进行深入语言学分析的缺点,Shah等[9]和陈志明等[10-11]利用词语的分布式表示和RNN语言模型等方法抽取描述译文质量的深度特征来提高机器译文质量估计与人工估计的相关性.与仅仅在传统的支持向量机回归模型中使用深度神经网络提取特征的方法相比,利用NMT中编码器-解码器模型构建端到端神经译文质量估计模型的方法,在近3年的WMT质量估计评测[12]中取得了最好的成绩,受到了广泛的关注.其中,Kim等[13]提出利用RNN来进行句子级别的译文质量估计,输入RNN的质量向量由基于注意力机制的双向RNN编码器-解码器模型提取,因此该模型是由两个独立训练的子网络构成; Kim等[14]将该模型命名为“预测器-估计器”模型,并将其扩展应用到词级别和短语级别的译文质量估计任务中; 为了更有效的训练“预测器-估计器”模型, Kim等[15]针对各种评价粒度的译文质量估计任务提出了使用堆传播算法联合训练两个子网络; 针对“预测器-估计器”中两个子网络独立训练和优化的问题,李茂西等[16]提出将这两个子网络组合成一个整体的端到端的神经网络模型,称为联合神经网络质量估计模型(unified neural network for quality estimation,UNQE),该模型根据译文质量估计任务,对整个神经网络进行联合训练与优化.以上使用RNN抽取特征.除此之外, Fan等[17]还提出使用带有自注意力机制和多头注意力机制的Transformer结构[6]抽取特征.

然而,同NMT类似,为了控制模型的复杂度,特别是输入层(查找表层或词嵌入层)节点的数量,端到端的神经译文质量估计也常常通过限定词表大小来降低模型训练和预测时的存储量和运算量.但是,限定词表大小会导致机器译文中出现较多的未登录词,而这些未登录词在译文质量估计时不能被正确地识别和评价,从而降低了译文质量估计系统的性能.

由于未登录词通常由命名实体、同源词、外来词和复合词等构成,NMT中通常使用子词替代词语对句子进行切分,包括字节对编码(byte-pair-encoder, BPE)[18]和基于一元文法语言模型(unigram language model, 简称Unigram)的子词切分方法[19].Sennrich等[18]提出在英德和英俄翻译中引入BPE子词切分方法来解决开放词汇(open vocabulary)的机器翻译问题; Kudo[19]提出在IWSLT(international workshop on spoken language translation)和WMT翻译任务中使用基于Unigram的子词切分方法.使用子词切分的方法可以较好地平衡词表的大小和模型训练与预测时的效率.并且在NMT译文质量估计系统中以子词为单位进行模型训练减少了未登录词数量,提高了机器翻译译文质量估计的性能.但是,在已有的NMT译文质量估计系统中还没有研究工作深入调查不同子词切分方法对译文质量估计效果的影响.针对这个问题,本研究在本课题组以往工作提出的UNQE模型[16]的基础上,分析BPE的子词切分和Unigram的子词切分对译文质量估计的影响,并将不同句子切分方法的译文质量估计得分进行融合来提高系统的译文质量估计性能.

1 UNQE模型

UNQE模型在WMT18句子级别质量估计任务中取得了优异的成绩[12],故本研究基于UNQE模型进行分析.UNQE模型[16]包括带注意力机制的基于双向RNN的编码器-解码器子网络和计算质量估计得分的单向RNN子网络,这两个子网络通过译文质量向量相连,其模型架构如图1所示.基于双向RNN的编码器-解码器子网络用于抽取译文质量向量,随后使用单向RNN子网络计算质量估计得分.图1中,x1,x2,…,xm为译文输入序列; h→1,h→2,…,h→m和h←1,h←2,…,h←m分别表示编码器-解码器子网络编码端的前向和后向隐藏状态; c1,c2,…,cn代表通过注意力机制计算的源语言的上下文向量; s0,s1,…,sn表示编码器-解码器子网络解码端的隐藏状态; y0,y1,…,yn为目标语言词汇的独热编码表示; v1,v2,…,vn代表计算质量估计得分的RNN子网络隐藏状态.

图1 UNQE模型结构图[16]

Fig.1 An illustration of the UNQE model architecture[16]由于计算质量估计得分的RNN子网络最后时刻隐藏层状态vn汇总了整句机器译文的质量信息,因此本研究用其来预测机器译文的质量估计得分:

SQE=WQE×vn,

其中,WQE是权重矩阵,SQE表示译文质量估计得分.质量估计得分实际是预测机器译文的人工后编辑工作量(human translation error rate,HTER),HTER的值RHTE取值范围在0~1之间,0表示机器译文无需人工后编辑,1表示机器译文中每个词均需要修改.因此本研究也将模型预测的每个句子质量估计得分限制在[0,1]之间.

假设译文质量估计任务的训练集中包含N个源语言句子和其对应的机器翻译,以及人工对每个机器译文的评价结果RHTE(i)(i=1,2,…,N).以人工评价的结果作为黄金标准,则模型训练的目标是寻找最优的参数集θ,使模型在训练集上预测值SQE与黄金标准之间的平均绝对误差最小:

θ ∧=arg minθ1/N∑Ni=1|SQE(x(i),y(i),θ)-RHTE(i)|,

其中,x(i)、y(i)分别表示第i个源语言句子和目标语言句子.

由于译文质量估计任务的训练集规模一般较小,仅包含2万组左右的源语言句子、机器译文和人工评价的三元组,使用它们不能准确地训练整个联合神经网络模型的所有参数,因此本研究分别使用机器翻译中大规模的双语平行语料和译文质量估计训练集对基于双向RNN的编码器-解码器子网络和计算质量估计得分的单向RNN子网络进行预训练,预训练可以视为模型参数粗略调整的过程; 最后,使用译文质量估计训练集对模型参数进行整体优化,这可以视为针对译文质量估计任务中模型细粒度优化的过程.

2 子词切分

在自然语言处理中,句子通常被表示为数字序号序列,其中每一个序号映射词表中唯一的词(或子词).与句子词语切分结果的确定性相比,同一句子使用不同子词方法切分,其切分结果不同.并且句子的不同切分方法适合于不同的自然语言处理任务.由于本研究主要探索在译文质量估计任务中基于BPE的子词切分和Unigram的子词切分对译文评价性能的影响,因此下面对其进行简要介绍.

2.1 基于BPE的子词切分方法BPE通过依次将序列中出现最频繁的字节对编码成一个新的字节,并使用新的符号将之替换以实现数据压缩.Sennrich等[18]将其应用在NMT中对句子进行切分以减少未登录词,与编码出现频率最高的字节对不同,基于BPE的子词切分方法是对出现频率最高的字符对或字符序列进行合并编码.

2.2 基于Unigram的子词切分方法基于Unigram的子词切分方法[19]假设每个子词出现的概率独立,一个句子有多种不同的可能的子词切分结果,其切分成某个子词序列的概率可以表示为其中所有子词出现的概率连乘积.寻找句子最优子词切分结果可以转化为句子出现的最大化概率问题,可通过Viterbi算法进行求解.在实际计算时,该算法通过启发式的策略从训练语料中初始化一个种子子词词表,并利用EM(expectation-maximization algorithm)算法估计每个子词出现的概率.

2.3 句子不同切分方法的直观比较基于BPE的子词切分方法和基于Unigram的子词切分方法本质上均是数据压缩算法,两种方法各有其特点.

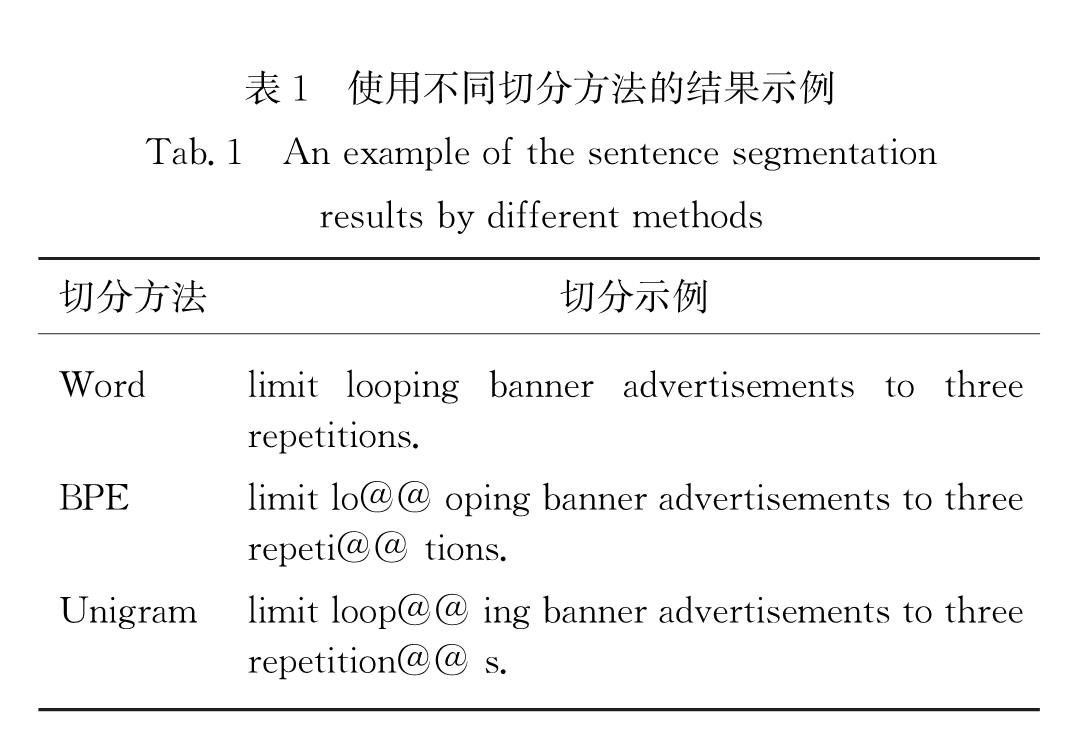

表1给出了WMT18句子级别质量估计任务训练语料中的一个英文句子使用不同子词(词语)切分方法的结果.其中:词语之间使用空格进行分割,而子词之间统一使用“@ @”符号进行分割(原始的基于Unigram的子词切分方法使用“_”符号进行分割); “Word”为词语切分,表示不使用任何子词切分方法.由表1可知句子利用Word切分、BPE切分和Unigram切分的结果主要差异体现在单词“looping”和单词“repetitions”的切分上.BPE切分和Unigram切分方法将单词“looping”分别切分为“lo”和“oping”、“loop”和“ing”两组子词,将“repetitions”分别切分为“repeti”和“tions”、“repetition”和“s”两组子词.这个切分结果清晰地表明Unigram切分方法将单词切分为保留了词语原始含义的子词,即保留了词语的词法含义; 而BPE切分则将单词切分为近似于词根和词缀的形态,即语料中出现频率较高的子串序列.

2.4 不同切分方法的融合由于基于BPE子词切分和基于Unigram的子词切分均是合理的句子切分方法,因此本研究提出将表1中3种切分方法融合的方法.

进一步,假设对源语言句子x和其对应的机器翻译y,设基于BPE的子词切分方法预测得到的质量估计得分为SBPEQE; 以此类推,基于Unigram的和基于Word切分的译文质量估计方法预测得分分别为SUnigramQE和SWordQE,则基于这3种不同切分粒度的译文质量估计方法融合后的预测质量估计得分为

ScombQE=(SBPEQE+SUnigramQE+SWordQE)/3.

3 实 验

3.1 实验设置为了比较基于不同子词切分的NMT译文质量估计的效果,并验证上述不同切分方法融合的UNQE的性能,本研究在WMT18句子级别质量估计评测任务(任务1)上进行了实验.WMT18句子级别质量估计评测任务涉及评价4个翻译方向的机器译文质量,即英语-捷克语、英语-拉脱维亚语、德语-英语和英语-德语,其中英语-德语和英语-拉脱维亚语翻译方向分别包含评价统计机器翻译系统(SMT)的输出译文和评价NMT系统的输出译文,即这两个翻译方向又分别进一步细化为两个子任务.

将WMT18机器翻译评测任务官方发布的双语平行语料来预训练基于本文中的双向RNN的编码器-解码器子网络,各翻译方向使用的语料名称及统计信息见表2所示.本研究对语料中源语言端和目标语言端的句子分别使用Word切分、BPE切分和Unigram切分,BPE切分方法的最大操作数设置为4.5万次,Unigram切分方法的词表大小设置为4万.

表2 编码器-解码器子网络预训练使用的双语平行语料及规模

Tab.2 The bilingual corpus and its size used to pre-train the encoder-decoder sub-network本研究将词嵌入向量维数分别设置为500和700,将计算质量估计得分的RNN模型隐状态维数分别设置为100,150和200,得到6组实例的结果,将该6组结果取平均值进行多实例集成.

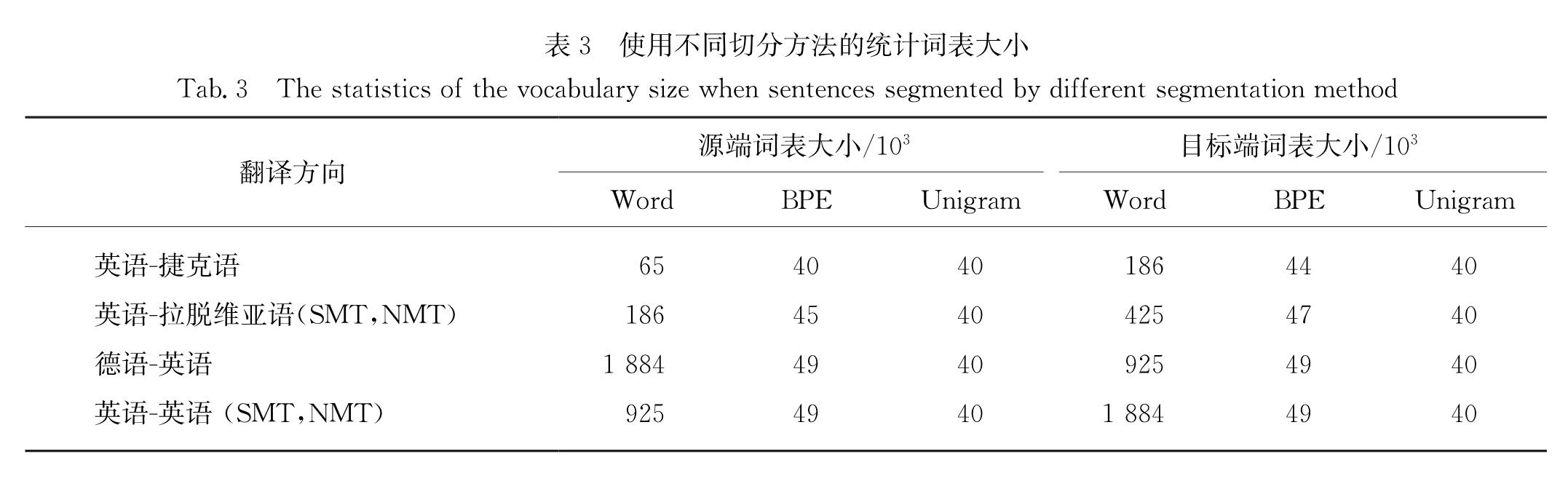

表3给出了双语平行语料分别使用Word切分、BPE切分和Unigram切分方法获取的词表大小统计信息.使用Word切分的词表大小远远超过使用BPE和Unigram切分的词表大小,在英语-德语和德语-英语评测方向上使用Word切分方法的词表大小超过使用子词切分的词表大小的18倍以上.为了减少UNQE模型的存储量和计算量,实验中将基于Word切分的UNQE模型的源语言端和目标语言端的词表大小均设置为4万.

3.2 实验结果遵循WMT18 句子级别质量估计评测任务官方的评价方法,将皮尔森相关系数(Pearson)用来测定机器译文质量估计与人工评价的打分相关性,斯皮尔曼相关系数(Spearman)用来测定机器译文质量排名与人工评价排名的排名相关性,它们的值越大,表明译文质量估计与人工评价的相关性越高,机器译文质量估计方法的效果越好.

表4和5给出了基于不同切分方法的UNQE模型性能与参与评测的译文质量估计系统性能的比较结果.需要说明的是由于WMT18质量估计评测任务不提供测试集答案供用户离线评价译文质量估计系统的性能,实验中本研究提出方法在测试集上的相关性数据均是在线提交待评价机器译文质量估计结果,由评测方提供的服务端自动计算得到.表中“Word+BPE+Unigram”表示不同切分方法的融合.除UNQE模型外的其他对比模型,包括SHEF-PT、SHEF-bRNN、UTartu/QuEst+Attention、UTartu/QuEst+Att+CrEmb3、QuEST、sMQE、uMQE、QEBrainDoubleBi w/BPE+word-tok、QEBrainDoubleBi w/BPE-tok、TSKQE1、TSKQE2、RTM MIX7、RTM MIX6等,为本实验对照的基线模型,基线模型均为WMT18句子级别质量估计评测任务参与的评测系统,其方法描述详见评测官方文档[12],表中相关性数据来自于评测官方公布的结果[12].

首先,表4和5的实验结果表明融合不同切分方法的UNQE模型一致地提高了评价效果,在所有子任务上融合系统都优于单种切分方法的系统,对Pearson相关系数的提高幅度介于0.01~0.04; 并且在5个子任务上超过了WMT18 句子级别质量估计任务参与评测的最好系统,仅在英语-德语NMT子任务上比最好的参与系统“QEBrainDoubleBi w/BPE+word-tok”Pearson相关系数低0.03.

其次,基于不同切分方法的UNQE模型之间具有较好的可比性:Word切分的UNQE模型在英语-捷克语子任务、英语-德语(NMT)子任务和英语-拉脱维亚语(NMT)子任务上取得了较好的性能; 基于BPE的子词切分的UNQE模型在德语-英语子任务、英语-德语(SMT,NMT)子任务上取得了较好的性能; 而基于Unigram子词切分的UNQE模型在英语-拉脱维亚语(NMT,SMT)子任务和德语-英语子任务上取得了较好的性能.这也间接说明了将不同切分粒度的译文质量估计结果进行融合的必要性.

最后,UNQE模型在英语-捷克语子任务、英语-拉脱维亚语(NMT,SMT)子任务上均比基线模型性能有大幅度的提高,这说明实验使用的UNQE模型具有较好的性能.

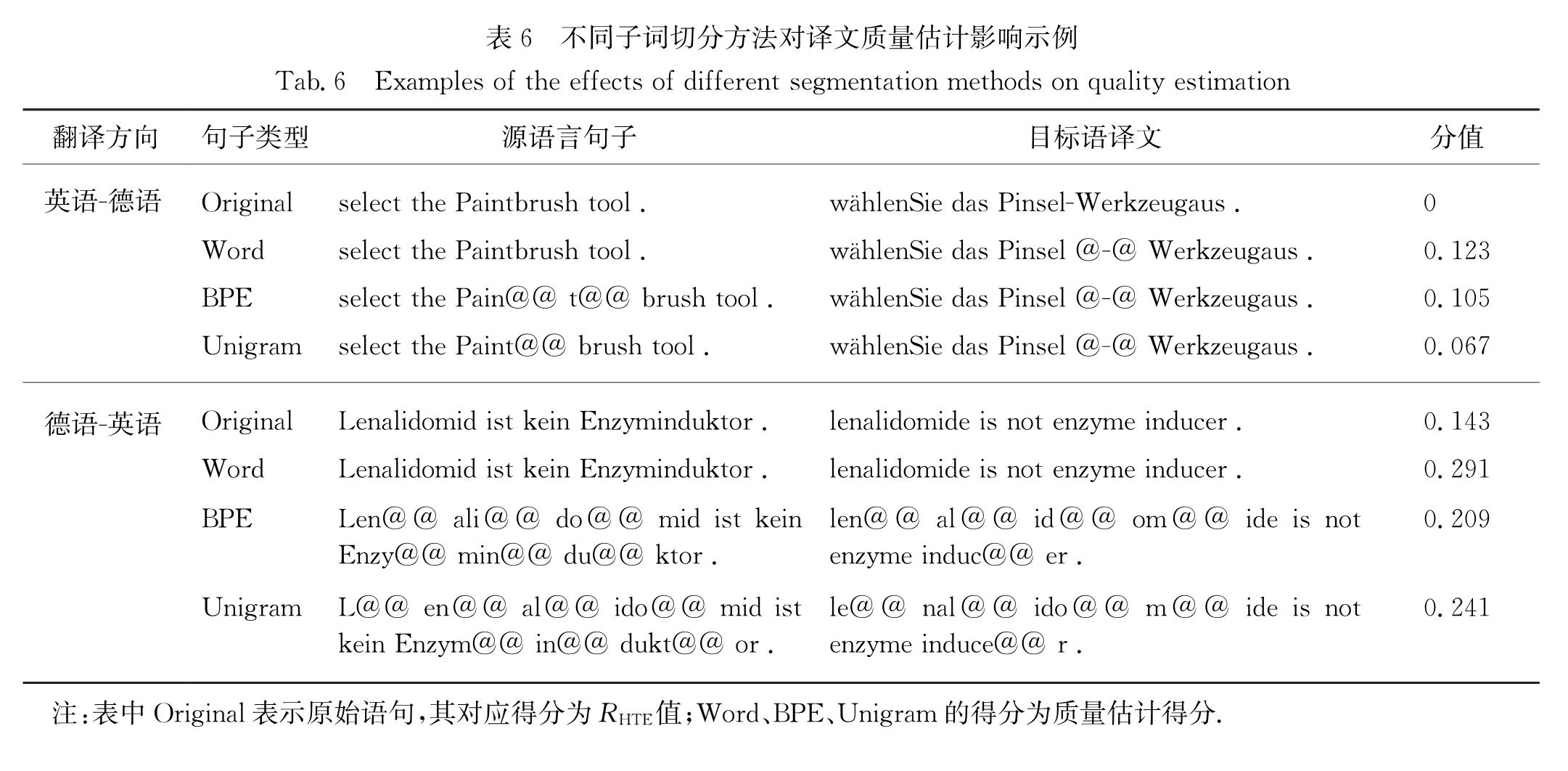

3.3 实验分析为了定性解释不同切分方法对译文质量估计的影响,表6列出了英语-德语和德语-英语评测子任务上的两个源语言句子和其机器译文对使用不同切分方法切分的结果,以及相应的译文的质量估计得分.对于BPE切分和Unigram切分,通过两个翻译方向的例句可以观察得出:两种子词切分方法均将较复杂或生僻的单词切分为子词形式.例如英语-德语方向源语言句子中“Paintbrush”被分别切分为“Pain”、 “t”和“brush”以及“Paint”和“brush”; 德语-英语方向目标语言句子中“lenalidomide”(来那度胺,一种抗癌药物名称)被BPE方法切分为“len”、“al”、“id”、“om”和“ide”

表4 不同模型在英语-捷克语和英语-拉脱维亚语翻译任务中的性能

Tab.4 The quality estimation performances of different models on the English-Czech and English-Latvian data set transtation tasks表5 不同模型在英语-德语和德语-英语翻译任务中的性能

Tab.5 The quality estimation performances of different models on the English-German and German-English data set translation tasks等子词.因为那些较复杂或较生僻的单词将被拆分为较常见的子词序列,所以子词切分能大幅度地减少限定词表大小给大规模语料造成的大量“未登录词”问题,即通过有限的词(子词)表示更多的单词形态,而不丢失信息.

但这两种子词切分方法的侧重点不相同.BPE切分方法侧重于把单词切分为词根和词缀的形式,而Unigram切分则注重于最大限度地保留词语的信息熵,即将单词尽可能切分为有实意的单词,这也是由其预定义的子词词表决定的.从英语(日耳曼语系)、德语(日耳曼语系)和拉脱维亚语(波罗的语系)的词源学角度来看,它们主要构词手段是借助包含有词的前缀和后缀的派生法(或词缀法),因此BPE切分方法实际上可能更适合这些语言.而对于词语可随句子构成部分变化而变化的捷克语来说,单词的形态变化多端,因此理论上不适用BPE切分.

对于词语切分和子词切分,词语切分有利于源语言句子与机器译文进行词对齐(注意力机制能很好地发挥作用),而子词切分方法由于源语言句子与机器译文中常出现的子词序列不同导致词对齐中出现较多噪声(注意力机制不能充分发挥作用).例如在英语-捷克语评测子任务中(限于篇幅,这里没有列出具体示例),单词“vectorizes”(矢量化)利用BPE子词切分方法,在源语言端被切分为“vec@ @ tor@ @ izes”,而在机器译文中则被切分为“vec@ @ tori@ @ ze”,因此,子词切分方法也可能对译文质量估计中提取质量向量特征带来不利影响,从而导致子词切分方法在这些翻译方向的译文质量估计任务中性能得不到提升.

由于不同的子词切分方法适合不同目标语言种类的机器译文质量估计任务,因此有必要对其进行系统融合以取长补短,并且实验结果也表明了融合后的UNQE模型一致地优于最好的单系统.

4 结 论

为了缓解未登录词不能正确识别和评价给机器译文质量估计带来的不利影响,本研究提出了基于BPE子词切分和基于Unigram子词切分的NMT译文质量估计方法,并将它们对译文质量估计的得分与基于词语切分的NMT的译文质量估计得分进行融合.实验结果表明,融合后的系统一致地提高了译文质量估计的效果.对使用不同粒度切分的待评价句对

表6 不同子词切分方法对译文质量估计影响示例

Tab.6 Examples of the effects of different segmentation methods on quality estimation实例的分析揭示了融合后的系统提高了译文质量估计的健壮性.

本文中使用的子词切分方法均是借鉴于NMT中的成熟方法,在以后的工作中将研究针对译文质量估计任务进行优化的子词(词语)切分方法.

- [1] SPECIA L,SHAH K,DE SOUZA J G,et al.QuEst-a translation quality estimation framework[C]∥Proceedings of the 51st Annual Meeting of the Association for Computational Linguistics:System Demonstrations.Sofia:ACL,2013:79-84.

- [2] MIKOLOV T,KARAFIÁT M,BURGET L,et al.Recurrent neural network based language model[C]∥Eleventh Annual Conference of the International Speech Communication Association.Makuhari:DBLP,2010:1045-1048.

- [3] MIKOLOV T,SUTSKEVER I,CHEN K,et al.Distri-buted representations of words and phrases and their compositionality[C]∥Advances in Neural Information Processing Systems.Lake Tahoe:NIPS,2013:3111-3119.

- [4] BAHDANAU D,CHO K,BENGIO Y.Neural machine translation by jointly learning to align and translate[EB/OL].[2019-08-01].http:∥arxiv.org/pdf/1409.0473.pdf.

- [5] SENNRICH R,FIRAT O,CHO K,et al.Nematus:a toolkit for neural machine translation[EB/OL].[2019-08-01].http:∥arxiv.org/pdf/1703.04357.pdf.

- [6] VASWANI A,SHAZEER N,PARMAR N,et al.Attention is all you need[EB/OL].[2019-08-01].http:∥arxiv.org/pdf/1606.02003.pdf.

- [7] 李亚超,熊德意,张民.神经机器翻译综述[J].计算机学报,2018,41(12):100-121.

- [8] 刘洋.神经机器翻译前沿进展[J].计算机研究与发展,2017:54(6):1144-1149.

- [9] SHAH K,NG RAVMOND W M,BOUGARES F,et al.Investigating continuous space language models for machine translation quality estimation[C]∥Proceedings of the 2015 Conference on Empirical Methods in Natural Language Processing.Lisbon:EMNLP,2015:1073-1078.

- [10] CHEN Z,TAN Y,ZHANG C,et al.Improving machine translation quality estimation with neural network features[C]∥Proceedings of the Second Conference on Machine Translation.Copenhagen:EMNLP,2017:551-555.

- [11] 陈志明,李茂西,王明文.基于神经网络特征的句子级别译文质量估计[J].计算机研究与发展,2017,54(8):1804-1812.

- [12] SPECIA L,BLAIN F,LOGACHEVA V,et al.Findings of the WMT 2018 shared task on quality estimation[C]∥Proceedings of the Third Conference on Machine Translation:Shared Task Papers.Belgium:ACL,2018:689-709.

- [13] KIM H,JUNG H Y,KWON H,et al.Predictor-estimator:neural quality estimation based on target word prediction for machine translation[J].ACM Transactions on Asian and Low-Resource Language Information Processing(TALLIP),2017,17(1):3.

- [14] KIM H,LEE J H.A recurrent neural networks approach for estimating the quality of machine translation output[C]∥Proceedings of the 2016 Conference of the North American Chapter of the Association for Computational Linguistics:Human Language Technologies.San Diego:NAACL,2016:494-498.

- [15] KIM H,LEE J H,NA S H.Predictor-estimator using multilevel task learning with stack propagation for neural quality estimation[C]∥Proceedings of the Second Conference on Machine Translation.Copenhagen:EMNLP,2017:562-568.

- [16] LI M X,XIANG Q Y,CHEN Z M,et al.A unified neural network for quality estimation of machine translation[J].IEICE Transactions on Information and Systems,2018,101(9):2417-2421.

- [17] FAN K,WANG J Y,Li B,et al."Bilingual expert" can find translation errors[C]∥Proceedings of the AAAI Conference on Artificial Intelligence.Hawaii:AAAI,2019:6367-6374.

- [18] SENNRICH R,HADDOW B,BIRCH A.Neural machine translation of rare words with subword units[EB/OL].[2019-08-01].http:∥arxiv.org/pdf/1508.07909.pdf.

- [19] KUDO T.Subword regularization:improving neural network translation models with multiple subword candidates[EB/OL].[2019-08-01].http:∥arxiv.org/pdf/1804.10959.pdf.

![图1 UNQE模型结构图[16]<br/>Fig.1 An illustration of the UNQE model architecture[16]](2020年02期/pic11.jpg)